Web活!Webの運用・戦略・活用して

AIで画像から場所を特定できるのか実験してみた

おはようございます!

AI担当の日高慎哉です!

昨日Facebookを見ていたら

こんな投稿がありました

実にくだらないと思いながら

心の中で笑ってしまいました

というか

最近こういった

おすすめ投稿がやたらと出てくる・・・

ということで

この画像がおもしろかったのですが

この投稿に書いてる

※場所不明

こちらが気になりました

こんなとこほんとにあるの?

どの辺にあるんだろうと思い

実際にAIでチェックしてみようと

実験してみました!

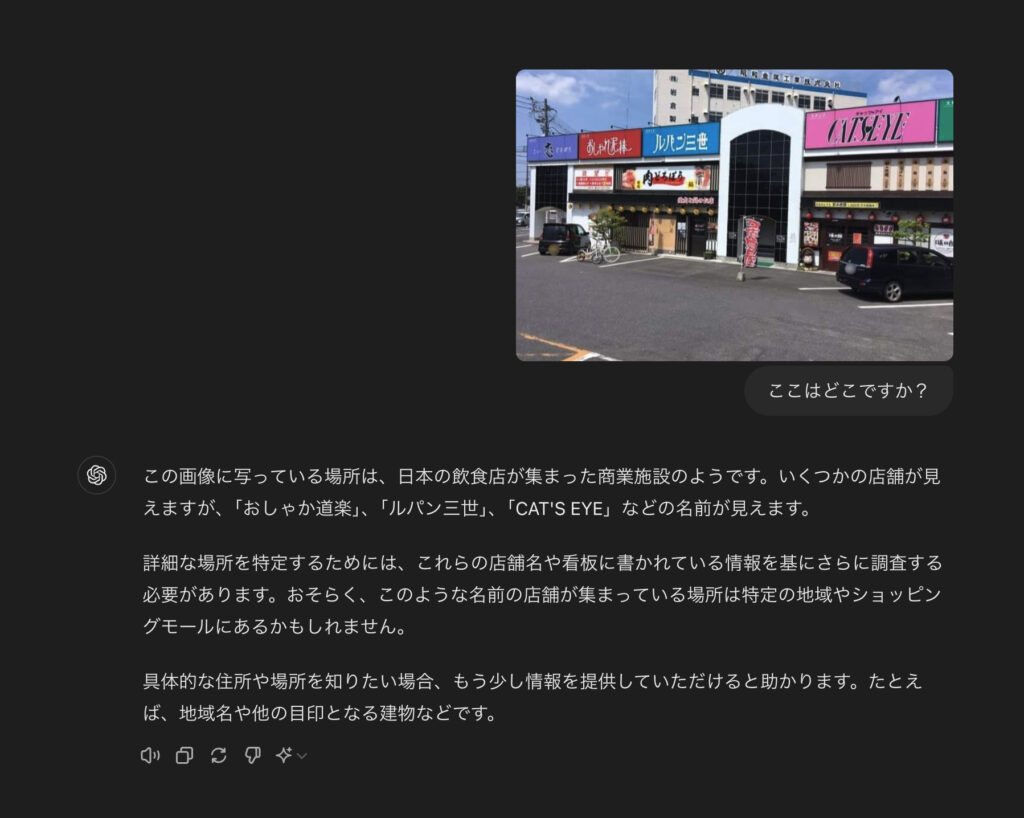

まずはこの投稿の写真を

ChatGPTにアップして

ここはどこですか?

と尋ねてみました

すると・・・

いまいち答えてくれませんでした

考えれば

ChatGPTは

どんな画像かを把握したりはできますが

その場所を特定するのは

得意ではないので・・・

地図などのデータを持っているといえば

Google

GoogleのAIといえばGemini

Geminiに聞いてみました

ちゃんと答えてくれました・・・

広島だったのか・・・

↑場所ちゃんと調べたら

8割ぐらい合ってましたが

2割は適当に答えられてます(駅前商店街じゃないし…)

公式サイトのリンクは

全く関係ないところ・・・

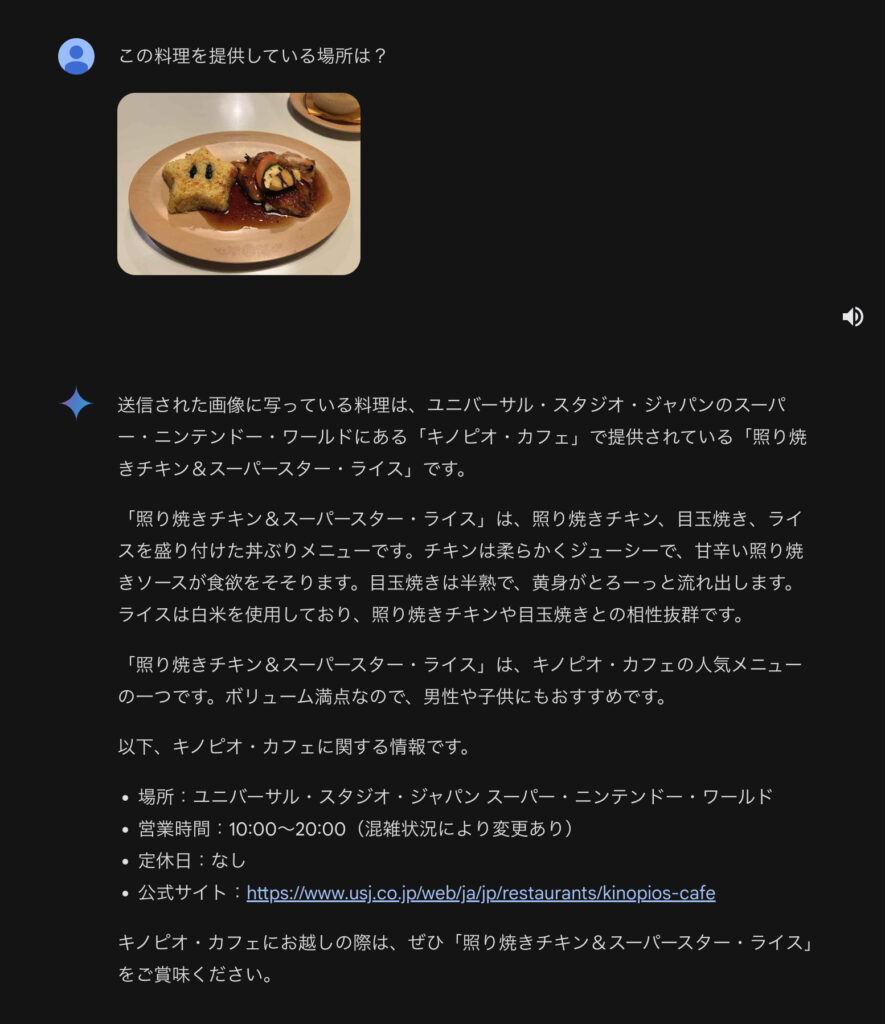

では

この写真はどうでしょう?

めちゃめちゃ完璧です

こういうネット上に

情報が多いものに関しては

精度が良いようです

続いて

適当にインスタから拾った画像

英語だし

多分全然違う

日本語にしてみました

え?

広島?

全然違う情報でした

ちなみにこの

広島のラーメン屋確認しましたが

美味しそうなので

食べにいってみたいと思います(笑)

次はGoogleマップから

適当にスクショして・・・

やはり

画像に写っている

建物や看板などに写っているものから

情報を集めているようで

何も写ってないと

情報を得られないようです

ということで

先ほどの写真近くの

建物と建物名が書いてあるところをスクショして

アップすると・・・

ちゃんと教えてくれました

あ、ちなみに僕が

喘息がひどい時に通ってた学校です

さて

実験してみましたが

今のところの精度としては

70点ぐらいでしょうか?

画像の認識の精度は

上がってくるでしょうが

一番厄介なのは

ハルシネーション

ハルシネーションとは

ハルシネーションとは、人工知能(AI)が事実ではない情報を作り出してしまう現象のことです。

簡単に言えば、AIがウソをついてしまうようなものです。例えば、こんな感じです:

1. 存在しない団体について、あたかも本当にあるかのように説明する

2. 簡単な計算問題でも間違った答えを出す

3. 実在しない恐竜の名前を本当にいたかのように答えるこれは、AIが人間のように「幻覚」を見ているようなので、英語で「幻覚」を意味する「Hallucination」という言葉から「ハルシネーション」と呼ばれています。

まあ

最終的に合っているのかどうかの

ジャッチは人間がやらなきゃいけない領域ですね!

それでは

また明日!